El desarrollo de tecnologías basadas en inteligencia artificial genera preocupación en muchos sectores. El director de cine James Cameron comparte esta sensación, por lo que advirtió sobre los peligros de la militarización de IA. Quien es considerado uno de los grandes cineastas de nuestro tiempo aseguró que el ser humano no sabe hacia dónde avanza en este campo. Además, consideró que existe un riesgo intrínseco en promover el uso de una tecnología que supera la capacidad humana en muchos sentidos.

El ganador del Premio Óscar dijo que el mayor riesgo que enfrenta la humanidad en este momento es la militarización de los sistemas basados en IA. En su opinión, no es un tema que deba ignorarse o postergarse dentro de la agenda internacional ¡sino todo lo contrario! El nivel de amenaza de esta situación es, como mínimo, equivalente a la preocupación que genera la carrera de armas nucleares.

“Yo creo que la militarización de la IA es el peligro más grande (…) Pienso que nosotros entraremos al equivalente de la carrera de armas nucleares con la IA, y si nosotros no la construimos, los otros chicos lo harán seguramente; por ende, esto irá escalando”, advirtió durante entrevista con CVT News, dejando claro que comparte el punto de vista de muchos expertos en tecnología.

¿Qué riesgos conlleva la militarización de IA?

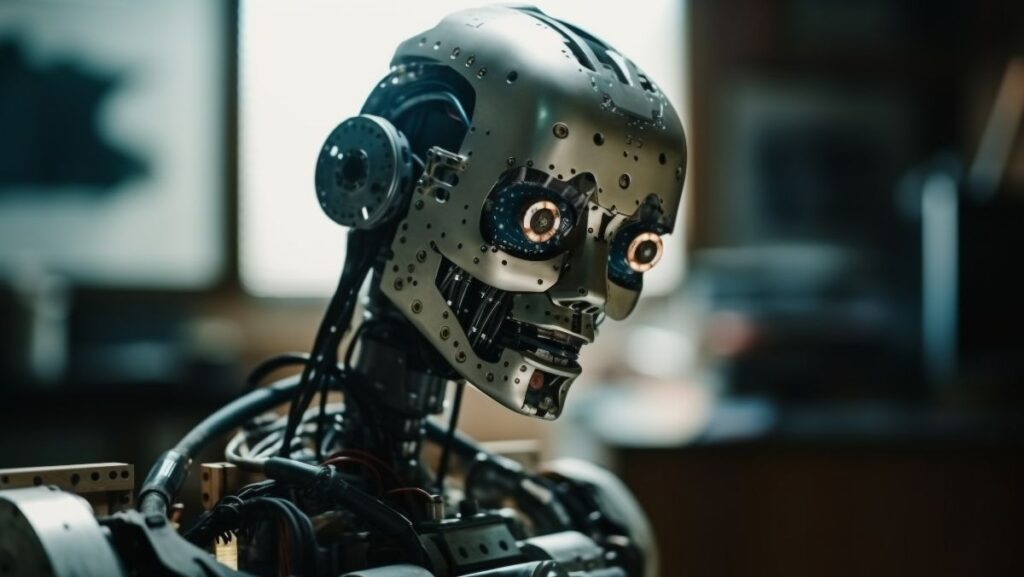

Dejando de lado por un minuto las advertencias de James Cameron, la militarización de la IA es una preocupación real y fundamentada. Pero ¿cuáles son los riesgos? En primer lugar, los especialistas señalan que sería peligroso crear armas totalmente autónomas, las cuales han sido bautizadas por algunos como “robots asesinos”. Estas máquinas serían capaces de intervenir sin activación o indicaciones de un ser humano, tomando decisiones de manera autónoma sobre cuándo utilizar la fuerza letal.

El impulso que provocará la inteligencia artificial dentro del ámbito militar recudiría el umbral para la mediación y negociación del conflicto. Además, provocará una carrera armamentista que incrementará las tensiones regionales y globales. A ello, se suman posibles comportamientos autónomos impredecibles que podrían traer consecuencias devastadoras. La malinterpretación de objetivos en un sistema militar eleva el riesgo de perpetrar ataques que deriven en muertes de civiles y el estallido de hostilidades entre naciones.

El uso de inteligencia artificial en el sector militar hará más complicado fincar responsabilidades en caso de crímenes de guerra y otro tipo de acciones. Esto ocurrirá debido a que habrá sistemas descentralizados de inteligencia artificial, por lo que es posible que muchos actos y crímenes de lesa humanidad queden impunes.

¿Qué opina James Cameron sobre la militarización de la IA?

El director de Terminator, James Cameron, fue más lejos en su ejercicio de imaginar un conflicto donde tuviera participación la inteligencia artificial. A su parecer, las guerras no se parecerían en nada a los episodios bélicos del pasado. Quedaría de manifiesto la incapacidad del ser humano para frenar las masacres. Además, una vez escalada la inteligencia artificial en los diferentes espacios de acción militar, será algo irreversible.

“Podrías imaginar una IA en un teatro de combate, todo siendo combatido por las computadoras a una velocidad que los humanos ya no pueden interceder, y no tienes la capacidad de desescalar”, agregó.

Los comentarios de Cameron sobre este tema nos recuerdan mucho a la crítica lanzada por el actor Arnold Schwarzenegger. Durante el evento donde fue el protagonista en la ciudad de Los Ángeles, el famoso exfisicoculturista y actor llegó a comparar los peligros que se retratan en Terminator con la realidad actual y la popularidad de las tecnologías de inteligencia artificial.

“Hoy, todos tienen miedo sobre eso, de hacia dónde va a ir esto [inteligencia artificial] (…) Y en esta película, en Terminator, hablamos de que las máquinas se vuelven conscientes de sí mismas y se hacen cargo de todo…Ahora, a lo largo de las décadas, se ha convertido eso en una realidad. Así que no es más fantasía o de tipo futurista. Hoy está aquí, y esa es la extraordinaria escritura de Jim Cameron”, agregó.

¿Qué podemos hacer para evitar los riesgos de la militarización de IA?

Por el momento, la humanidad se encuentra en un limbo sobre las regulaciones y restricciones que se pueden imponer sobre la militarización de la inteligencia artificial. Entre las acciones que sugieren algunos especialistas, se encuentran:

- Desarrollar normas internacionales para el uso de la IA en el ámbito militar

- Promover la transparencia y la responsabilidad en el desarrollo y el uso de la IA militar

- Invertir en la investigación y el desarrollo de IA segura y ética

- Educar a los ciudadanos sobre los riesgos y los beneficios de la inteligencia artificial de carácter militar

De esta manera, habría una mayor conciencia para eludir a toda costa el desarrollo de armas autónomas capaces de matar sin intervención humana. Tampoco se debe promover la creación de sistemas de vigilancia para reprimir disidencias, ni mucho menos el uso de IA para la manipulación de las personas y la opinión pública.

Conclusión: Lo que debes recordar sobre la militarización de IA

- La militarización de la IA representa un peligro inminente y comparable a la carrera de armas nucleares, advierte el director James Cameron.

- Los riesgos de la militarización de la IA incluyen la creación de armas autónomas o “robots asesinos”, que tomarían decisiones letales sin intervención humana.

- La presencia de inteligencia artificial en el ámbito militar disminuiría las posibilidades de mediación y negociación de conflictos, aumentando las tensiones globales y regionales.

- Los sistemas descentralizados de IA podrían dificultar la responsabilidad en caso de crímenes de guerra y acciones violentas, dejando muchos actos impunes.

- La falta de control sobre la IA en el campo militar podría conducir a conflictos impredecibles e irreversibles, con la humanidad incapaz de frenar masacres.

Si te interesa estar informado sobre los desarrollos en inteligencia artificial, síguenos en nuestras redes sociales ¡Nos encuentras como Hiramnoriega.com!